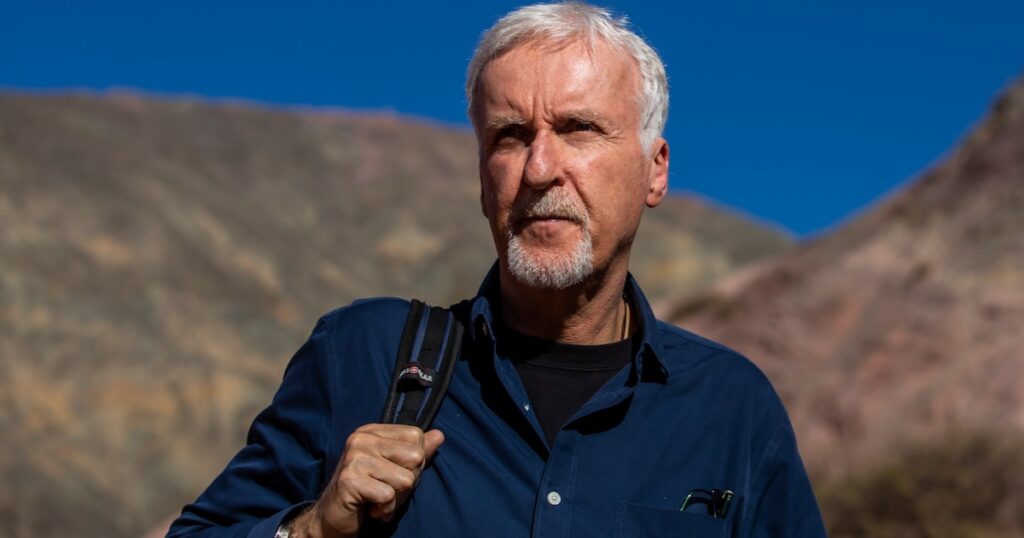

A filmrendező James Cameron újra a közvélemény elé állt egy figyelmeztetéssel, amely egyszerre aktuális és nyugtalanító. Bár a mesterséges intelligencia szerinte sok területen hasznos, az autonóm fegyverrendszerek és a nukleáris elrettentés összekapcsolása olyan kockázat, amelyet nem lehet félvállról venni. A popkultúrában gyökeret vert, Terminator-szerű összeomlás képe nem puszta fantázia, hanem egy technológiai rendszerkockázat lehetséges végpontja.

Egy rendkívüli túlélő története és egy új filmterv

Cameron új projektje, a Ghosts of Hiroshima adaptációja, a túlélés és a megbocsátás paradox tanúságtétele. A történet középpontjában Tsutomu Yamaguchi áll, aki hihetetlen módon két nukleáris robbanást is túlélt. A férfi évtizedeken át a nukleáris fegyverek ellen emelte fel a szavát, mégis a megbékélés hangján szólt. Az alkotó szerint Yamaguchi üzenete egyszerű, de emberséges: a megbocsátás nem felejtés, hanem a jövőért vállalt felelősség.

Cameron úgy véli, a mozi képes feloldani az ideológiai falakat, ha a nézőt tanúvá teszi. Nem vitatkozni akar, hanem mutatni: egy arcot, egy családot, egy várost, amelyen végigfut a pusztítás hulláma. A cél, hogy a célpont mögött újra embert lássunk, akinek éppúgy szüksége van szeretetre és biztonságra, mint bárki másnak.

„Mindig maradjon ember a döntési láncban” – hangsúlyozza Cameron.

A technológia kettős természete

A rendező nem technofóbiás, sőt a vizuális effektek terén az MI-t hatékonynak tartja. A mesterséges intelligencia képes csökkenteni a költségeket, gyorsítani a munkafolyamatokat, és új eszközöket adni az alkotóknak. Ugyanakkor a forgatókönyvírásban szerinte az MI nem ér fel az emberi tapasztalás, a fájdalom, az irónia és a katarzis rétegeivel. A művészet lényege a személyesség, amelyet nem lehet puszta mintakövetéssel és valószínűségi modellekkel pótolni.

A katonai felhasználás terén a helyzet még élesebb. Az autonóm döntéshozatal, ha éles fegyverekkel párosul, meghívja a hibát, a félreértelmezést és a láncreakciókat. Minél rövidebb a reakcióidő és minél nagyobb az adatzaj, annál inkább nő a téves és végzetes döntések esélye.

Három egzisztenciális fenyegetés

Cameron három, egymást erősítő veszélyt lát, amelyek egyszerre érik el a csúcsukat:

- A klímaváltozás és az ökológiai leépülés

- A nukleáris fegyverek és a proliferáció

- A szuperintelligens MI kiszámíthatatlan hatásai

Ezek nem különálló problémák, hanem egymást felerősítő rendszerek. A klímaválság növeli a geopolitikai feszültséget, a feszültség táplálja a fegyverkezést, a fegyverkezés pedig az automatizálás felé tolja a parancsnoki és irányítási rendszereket.

Miért kockázatos az MI és a nukleáris elrettentés összekapcsolása?

A modern hadviselésben a helyzetértékelés ciklusai félelmetesen gyorsak, ezért csábító azokat MI-vel automatizálni. Ha azonban szenzorhálózatok, kiberfigyelés és rakétavédelmi rendszerek MI-vezérelt láncba kapcsolódnak, a téves riasztás könnyen végzetes spirálba fordulhat. A hibák nem mindig technikaiak, gyakran adatminőségi vagy kontextuális félreértésekből fakadnak. Ami a szimulációban biztonságos, az valós terepen váratlan kölcsönhatásokba ütközhet.

A nukleáris doktrínák története tele van majdnem-katasztrófákkal, amelyeket egy-egy emberi döntés állított meg. Ha ezt a „végső” féket kivesszük a rendszerből, a hibák árát már nem lehet visszafordítani. A „gépek tévedhetetlenségébe” vetett hit itt nem erény, hanem veszélyes illúzió.

A tanúságtétel ereje és a közös felelősség

Cameron új filmterve nem pusztán kórkép, hanem empátiát keltő tanúságtétel. Yamaguchi példája arra figyelmeztet, hogy a történelem nagy erőszakhullámai mögött mindig emberi arcok és törékeny életek állnak. A megbocsátás nem az igazság eltörlése, hanem a jövő lehetőségének megőrzése. A művészet itt nem díszlet, hanem eszköz, amellyel visszaállítható a világ erkölcsi mélységének érzékelése.

A közvélemény, a tudomány és a politika közti párbeszéd nem helyettesíti egymást, hanem egymást feltételezi. Szükség van átlátható szabályokra, nemzetközi normákra és a „human-in-the-loop” elv rögzítésére kritikus döntések esetén. Még ha a hadszíntér sebessége nő is, a végső szó nem kerülhet teljesen a szoftverek kezébe.

Cameron figyelmeztetése épp attól erős, hogy nem hisztérikus, hanem tapasztalatra és történelmi tanulságokra épít. A jövőt nem a félelem, hanem a felelősség és a józan intézményépítés védi meg. Ha a technológiát az emberi méltóság szolgálatába állítjuk, akkor a sci-fi rémálom helyett közös, élhető jövőt építhetünk.